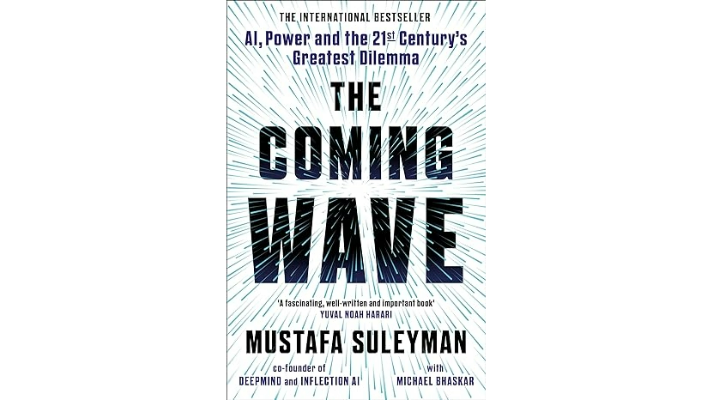

Recenzja książki Mustafy Suleymana i Michaela Bhaskara „The Coming Wave. Technology, Power, and the Twenty-First Century’s Greatest Dilemma”, Crown, 2023, s. 333

Jest spora szansa na to, że 2023 zapisze się w historii ludzkości jako rok przebudzenia w temacie sztucznej inteligencji (ang. artificial intelligence, AI). Rozpoczęliśmy go od zdumienia skalą możliwości generatywnej AI, w które wprawił nas wypuszczony pod koniec 2022 r. ChatGPT. Następnie przeszliśmy do rozważania potencjalnego wpływu na ludzkość jeszcze mocniejszej sztucznej inteligencji. Do pobudzenia debat przyczyniły się zwłaszcza zainicjowany przez Future of Life Institute list otwarty, w którym m.in. takie tuzy jak Elon Musk, Steve Wozniak czy Yuval Noah Harari wzywały do tymczasowego wstrzymania prac nad badaniami nad silniejszą AI, czy alarmistyczne głosy światowych intelektualistów i przedstawicieli biznesu, że ogólna sztuczna inteligencja (AGI) – taka, która mogłaby przewyższać „zdolnościami umysłowymi” człowieka – może stanowić ostatni wynalazek ludzkości. Śledziliśmy też próby regulacji sztucznej inteligencji, na czele z – wciąż procedowanym – EU AI Act, który próbuje skategoryzować różne prace nad AI pod kątem ryzyka i dla poszczególnych kategorii wyznaczyć adekwatne reguły postępowania. Pod koniec roku zaś obserwowaliśmy melodramat w OpenAI – wiodącej firmie pracującej nad rozwojem AGI – która postanowiła zwolnić, a następnie przywrócić do obowiązków, swojego CEO Sama Altmana. Trudno nie uznać za znak czasów tego, że perypetie amerykańskiej firmy były śledzone przez światową opinię publiczną z nie mniejszą uwagą niż choćby tzw. Bunt Prigożyna, który wstrząsnął Rosją w czerwcu 2023 r.

W klimat przebudzenia w temacie AI wpisuje się najnowsza książka Mustafy Suleymana i Michaela Bhaskara „The Coming Wave. Technology, Power, and the Twenty-First Century’s Greatest Dilemma”. Stanowi ona próbę podsumowania najważniejszej rewolucji technologicznej XXI wieku – jej elementów składowych, istoty, konsekwencji dla życia społeczno-polityczno-gospodarczego – która zawiera także autorską próbę znalezienia odpowiedzi na podstawowy problem: co zrobić, by ta rewolucja nie doprowadziła do końca ludzkości. Gdy dodatkowo uwzględnimy to, że autor wiodący książki, Mustafa Suleyman, jest współzałożycielem tak istotnych dla rozwoju AI firm jak DeepMind czy Inflection AI, staje się jasne, że jest to pozycja obowiązkowa dla wszystkich, których interesuje przyszłość.

Fale, dylematy i powstrzymywanie

Metafora fali jest kluczowa dla zrozumienia myśli autorów. W słowniku, który otwiera książkę, definiują ją jako “globalne rozpowszechnienie lub rozprzestrzenianie się generacji technologii zakotwiczonej w nowej technologii ogólnego przeznaczenia”. Za tą formułką ukrywa się głębsza historia. Suleyman i Bhaskar zauważają, że niemal każda kultura posiada mit związany z powodzią. Jego istotą jest “wielka fala zmywająca wszystko, co stanie na jej drodze, pozostawiająca świat przerobiony i odrodzony”. Takimi falami w historii ludzkości były też procesy powstawania i upowszechniania przełomowych technologii – od ognia i narzędzi kamiennych, przez kilofy i pługi, po telefony i samoloty. Cechowały się one dodatkowym wspólnym mianownikiem. Z czasem stawały się tańsze i łatwiejsze do użycia, co owocowało ich szerokim upowszechnieniem. Proliferacja technologii była w zasadzie niemożliwa do powstrzymania.

Obecnie ludzkość stoi w obliczu kolejnej fali, na którą składają się dwie główne technologie: sztuczna inteligencja i biologia syntetyczna. Suleyman i Bhaskar podkreślają, że tworzą one zupełnie nowe możliwości rozwoju, dając nadzieję na tworzenie wartości o bezprecedensowej skali, ale jednocześnie stanowią zagrożenie, potencjalnie nawet egzystencjalne. Jest to największe wyzwanie XXI wieku. Sprowadza się ono do stwierdzenia, że przyszłość ludzkości “zarówno zależy od tych technologii, jak i jest przez nie zagrożona”. Być może zatem, jak argumentowali autorzy, bardziej właściwe byłoby mówienie nie o fali, a o tsunami.

Suleyman i Bhaskar wskazują, że zarówno rozwijanie tych technologii, jak i zaprzestanie prac nad nimi wiąże się z licznymi ryzykami. Czy jako ludzkość możemy pozwolić sobie na to, aby nie skorzystać z potencjału AI do rozwiązywania najbardziej palących problemów planety? Czy bylibyśmy w stanie powstrzymać ich rozwój i upowszechnianie w świetle spadających kosztów, wzrastającej łatwości ich wykorzystania i pokus, jakie rodzą, np. dla autorytarnych rządów, które mogą chcieć je wykorzystać do kontroli nad populacją? Co zrobić z ryzykami, które mogą mieć tak daleko idące konsekwencje jak upadek państw, sztucznie wywoływane pandemie czy koniec ludzkości? To, że obecnie ogólny obraz przyszłości tych dwóch technologii wygląda tak, jakby ich wykorzystanie miało doprowadzić świat albo do katastrofalnych, albo do dystopijnych konsekwencji, autorzy uważają za największy dylemat XXI wieku. Odpowiedzią na niego ma być „powstrzymywanie” (ang. containment) – pojęcie zaczerpnięte ze studiów strategicznych, które Suleyman i Bhaskar definiują jako „zdolność do monitorowania, ograniczania, kontrolowania, a potencjalnie nawet eliminacji technologii”.

Cztery stopnie wtajemniczenia

Niewątpliwą zaletą książki jest pierwszy rozdział, który pełni funkcję wprowadzenia i zawiera syntetyczny opis głównych myśli autorów. Po jego lekturze czytelnik rozumie już najważniejsze pojęcia i zamysł, jaki przyświecał Suleymanowi i Bhaskarowi. Jest to zabieg, który idealnie wpisuje się w potrzeby czytelnika XXI wieku – często zmuszonego do konsumowania treści w pośpiechu i partiami. Z pewnością jest to również ułatwienie dla czytelników dobrze zaznajomionych z tematami, o których traktuje publikacja – dzięki lekturze pierwszego rozdziału będą oni w stanie zrozumieć jej wartość dodaną.

Pozostałe części książki – cztery, podzielone na mniejsze rozdziały – stanowią uzupełnienie i rozwinięcie tych głównych myśli. W części pierwszej autorzy opisują, jak w historii ludzkości dochodziło do upowszechniania się przełomowych technologii, akcentując to, że gdy tylko proces nabierał charakteru falowego, stawał się w zasadzie niepowstrzymywalny. Zwracają w niej również uwagę na problemy związane z powstrzymywaniem. Opisują np. ostatecznie nieudane próby sułtana osmańskiego, który wzdrygał się na myśl o upowszechnieniu na swych ziemiach druku, i w miarę skuteczne próby powstrzymywania, np. dążące do ograniczenia proliferacji broni nuklearnej. W części drugiej charakteryzują obecną falę, opisując rozwój AI i biologii syntetycznej, a także przedstawiając szerszy klaster technologii, które są z nimi związane. Najważniejszym rozdziałem jest ten, w którym opisują cechy charakterystyczne fali, wskazując na to, że jest ona: asymetryczna, hiperewolucyjna (chodzi o wysokie tempo rozwoju technologii), wszechstronna (technologie, jak np. AI, można wykorzystać do różnych celów i w rozmaitych obszarach, w kontrze np. do broni nuklearnej, której przeznaczenie jest ograniczone) i autonomiczna. Tę część zamyka opis bodźców sprzyjających rozwojowi fali. Należą do nich m.in. duma narodowa i potrzeby strategiczne państw (patrz wyścig między Stanami Zjednoczonymi a Chińską Republiką Ludową), dążenia naukowców do dzielenia się wiedzą, konkurencja między nimi i ich potrzeba uznania, a także potencjał do generowania zysków czy rozwiązywania światowych problemów.

W części trzeciej książki Suleyman i Bhaskar zabierają czytelników w podróż po potencjalnych konsekwencjach fali. Wskazują np. na ryzyko zagrożeń asymetrycznych (m.in. ataki terrorystyczne przy wykorzystaniu broni biologicznej zaprojektowanej dzięki AI), wyzwania dla stabilności państw narodowych i przeobrażenia w obszarze potęgi, wzmożenie dezinformacji, która może jeszcze bardziej podzielić społeczeństwa, wycieki z laboratoriów pracujących nad nowymi wirusami czy zagrożenia dla rynku pracy i stabilności społecznej związane z automatyzacją. Wydźwięk tej części książki jest jasny – obecna fala może przeobrazić niemal wszystkie obszary fundamentalne dla funkcjonowania społeczeństw. Te rozważania doprowadziły autorów do kluczowego wniosku: “Spójrz na świat, a wyda ci się, że powstrzymywanie jest niemożliwe. Spójrz na konsekwencje, a coś innego stanie się równie wyraźne: dla dobra wszystkich powstrzymywanie musi być możliwe”.

W części czwartej książki Suleyman i Bhaskar uzasadniają, dlaczego powinniśmy mówić o polityce powstrzymywania – same regulacje to nie wszystko (!) – i przedstawiają wytyczne dla niej w ramach dziesięciu kroków. Zawierają one kompleksowe spojrzenie, w ramach którego autorzy postulują działania choćby w zakresie ustanowienia środków bezpieczeństwa rozwoju technologii, mechanizmów audytowych, zwiększenia świadomości twórców i przedstawicieli biznesu, procesów regulacyjnych ze strony państw, w tym traktatowych na poziomie międzynarodowym, a nawet zmian kulturowych. Suleyman i Bhaskar mają świadomość tego, że wprowadzenie zmian w tak wielu obszarach będzie niezwykle trudne. Wyrażają jednak przekonanie, że jest to jedyny sposób na to, żeby “wielka fala” nie pozbawiła nas przyszłości.

***

Książka “The Coming Wave. Technology, Power, and the Twenty-First Century’s Greatest Dilemma” to ciekawy głos w dyskusji na temat przyszłości. Szczególnie warto docenić kreatywność i interdyscyplinarność autorów – to, że zaczerpnęli jedno z kluczowych pojęć studiów strategicznych, i zaadaptowali je na własne potrzeby. Zabieg jest tym bardziej udany, że mówienie o powstrzymywaniu w kontekście nowoczesnych technologii popycha dyskusje o ich przyszłości na nowe tory. Przede wszystkim pozwala na to, aby przestała ona kręcić się wyłącznie wokół regulacji i tych – jakże już oklepanych! – debat o tym, jak tworzyć prawo, żeby nie hamować innowacji.

Autorzy w przekonujący sposób przedstawiają ryzyka związane z rozwojem nowoczesnych technologii, które tworzą obecną falę. Udaje im się przy tym uniknąć wpadnięcia w pułapkę sporu technooptymiści vs. technopesymiści. Wielokrotnie wskazują, że są pod wrażeniem możliwości, które tworzą nowoczesne technologie, ale uważają, że debata o tym bez równoczesnego zarysowywania ryzyk – zwłaszcza gdy są one tak duże – byłaby nieuczciwa. Spore wrażenie wywołuje też sposób prowadzenia narracji przez Suleymana i Bhaskara – książka jest napisana w taki sposób, że czytelnik jest w stanie bez problemu pojąć ich tok rozumowania, dostrzec połączenia między ich głównymi argumentami, zauważyć, w jaki sposób dotarli do swego przekonania o konieczności wypracowania polityki powstrzymywania. Ta spójność w argumentacji niweluje drobne wady, np. tę, że autorzy poświęcają więcej uwagi AI niż biologii syntetycznej. Utrzymanie takiej narracji było też z pewnością niełatwe, biorąc pod uwagę to, jak wiele dylematów towarzyszy rozwojowi nowoczesnych technologii (i towarzyszyło autorom przy pisaniu publikacji).

Bardzo dobre wrażenie robi również to, że Suleyman jest krytyczny wobec środowiska, z którego się wywodzi. W przeciwieństwie do swoich technobraci i technosióstr nie przekonuje czytelnika, że technologie są neutralne, przerzucając odpowiedzialność na użytkowników. Wręcz przeciwnie, wskazuje, że twórcy technologii, które ostatecznie mogą wywrócić do góry nogami życie ludzkości, muszą być świadomi potencjalnych skutków swoich prac i odpowiedzialności, jaka na nich spoczywa, tak jak niegdyś świadomi tego byli naukowcy pracujący nad bronią atomową. Podobnie jest z badaczami AI – w swoich pracach powinni kierować się nie tylko potrzebą zdobycia uznania i potwierdzenia statusu, lecz także dobrem ludzkości i etyką.

Niektórym te postulaty mogą wydawać się przesadzone (porównywanie badaczy nad AI do naukowców pracujących nad bronią atomową?), a być może nawet niesprawiedliwe. Jednak ich konfrontacja z ryzykami, które towarzyszą nowoczesnym technologiom, a także fakt, że Suleyman i Bhaskar wskazują na szerszy katalog podmiotów odgrywających rolę w wypracowywaniu polityki powstrzymywania, czynią je przekonującymi. Uwiarygadniającą funkcję pełni też inny argument autorów – że ich propozycje to tylko zaproszenie do dyskusji, Powoduje on, że czytelnik nieco mniej krzywi się na rekomendacje, które mogą wydawać się zbyt szerokie czy wręcz naiwne (powodzenia z wypracowywaniem globalnych traktatów regulujących AI w dobie konfrontacji między USA a ChRL zachodzącej m.in. wokół rozwoju tej technologii). Znacznie przychylniej patrzy też na fundamentalną myśl Suleymana i Bhaskara: powstrzymywanie jest tak trudne, że może wydawać się niemożliwe, ale ze względu na ryzyka związane z nowoczesnymi technologiami musimy zrobić wszystko, żeby było możliwe. Możliwe, że we współczesnym świecie, przepełnionym zawiłymi problemami, tylko równie zawiłe rozwiązanie uratuje nam przyszłość.